Détectez les images générées par IA

Notre détecteur d'images IA repère automatiquement les images IA, les deepfakes et les manipulations par IA. Vérifiez l'authenticité des images et protégez-vous des médias synthétiques avec notre technologie IA de pointe.

Détectez les images générées par IA

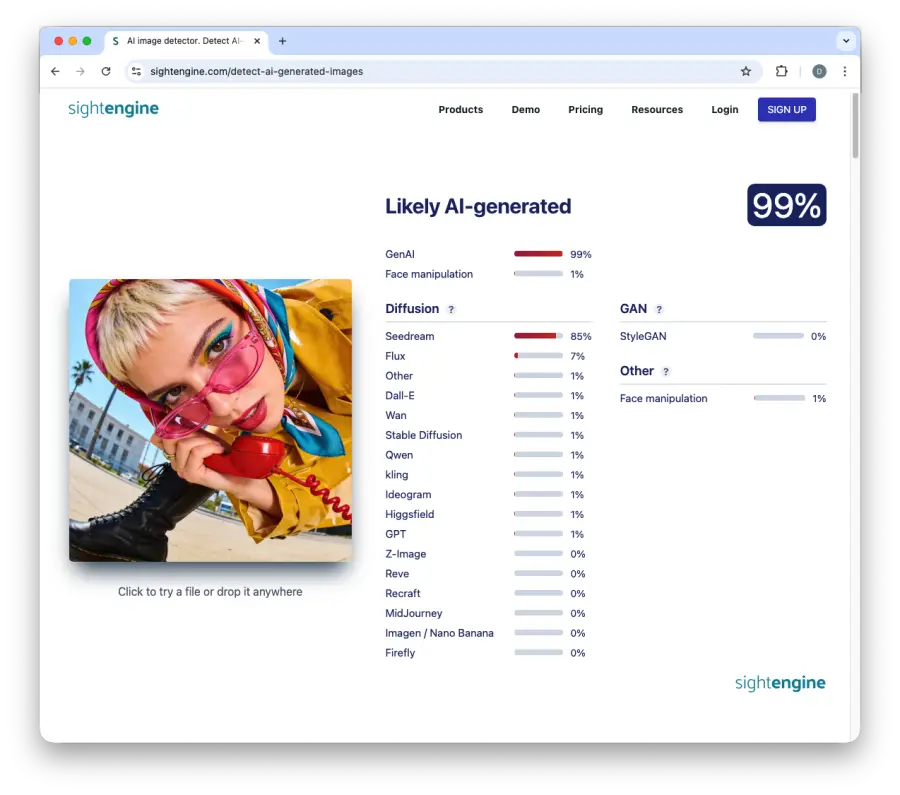

Probablement générée par IA

Probablement un Deepfake

Probablement ni générée par IA, ni un Deepfake

Incertain si générée par IA ou pas

Incertain si c'est un Deepfake ou pas

Détectez les manipulations, deepfakes, fraudes, abus, spams...

Désinformation

Propagation de fausses informations et de deepfakes générés par IA dans les médias.

Déclarations de sinistre

Élaboration de fausses déclarations d'assurance à partir de fausses images d'incidents domestiques.

Faux profils

Arnaque des utilisateurs avec de faux profils sur les réseaux sociaux.

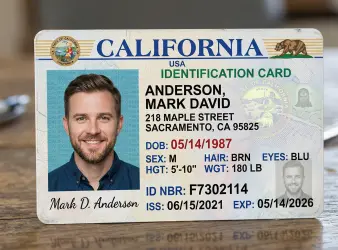

Faux papiers d'identité

Contournement des contrôles KYC ou AML à l'aide de papiers d'identité et de selfies faux ou falsifiés.

Spam sur les sites marchands

Spam et inondation des sites marchands avec des variations d'images générées automatiquement.

Fausses preuves

Génération de constats d'accident frauduleux à l'aide d'images générées par IA.

Usurpation d'identité

Utilisation de l'image d'une personne sans son consentement pour induire les autres en erreur.

Nudification

Génération d'images abusives pour nuire aux utilisateurs à travers l'usurpation d'identité ou la nudification.

Fake news

Propagation de fake news pour nuire aux principes démocratiques.

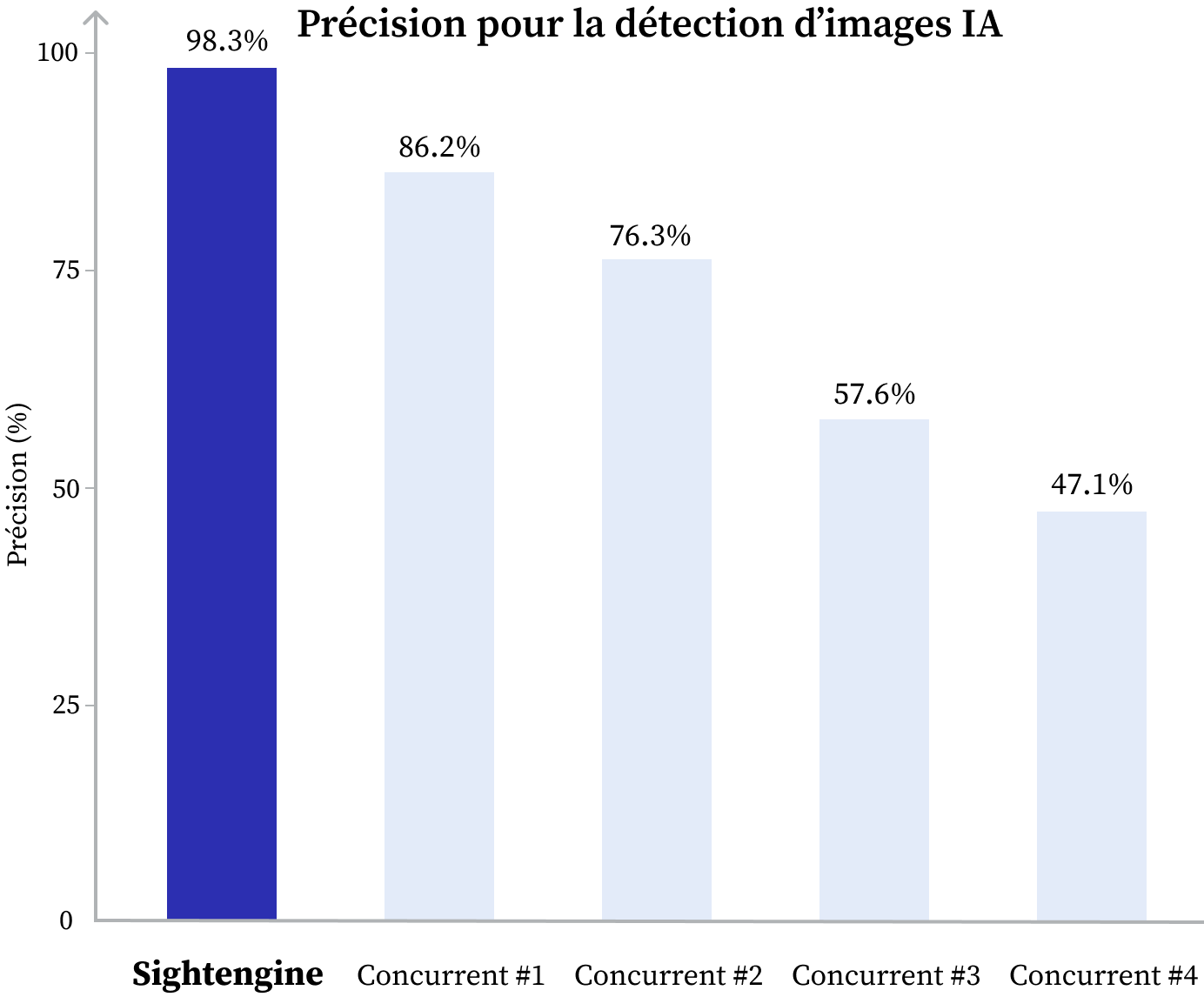

La meilleure solution selon cette étude comparative externe.

La plus haute précision en matière de détection de médias générées par IA

Source: Étude de l'Université de Rochester et de l'Université du Kansas

Cette recherche externe a été menée sur 80000 images, comprenant à la fois des images réelles et des images artificielles produites par divers modèles de génération d'images à partir de texte. Ces images étaient nouvelles et par conséquent inconnues des participants testés.

L'article de recherche est disponible ici.

Fonctionne avec de nombreux générateurs d'images.

Notre outil de détection automatique d'images générées par IA vous aide à déterminer la provenance et l'authenticité des images.

Nous facilitons l'identification des images provenant des générateurs les plus populaires tels que :

GPT-2

GPT-2 MidJourney

MidJourney Stable Diffusion

Stable Diffusion Ideogram

Ideogram Flux

FluxImage generators

| Generator | Creator | Example versions detected |

| DALL-E | OpenAI | DALL-E 2, DALL-E 3, ... |

| Firefly | Adobe | Firefly 2, Firefly 3, ... |

| Flux | Black Forest Labs | Flux.1 Dev, Flux.1 Schnell, Flux Pro, ... |

| GPT image generation | OpenAI | GPT-4o, GPT-1.5 image... |

| Grok Imagine | xAI | Imagine, Imagine Pro... |

| Higgsfield | Higgsfield AI | Higgsfield Soul... |

| Ideogram | Ideogram | Ideogram 2.0, Ideogram 3.0, ... |

| Imagen | Imagen 2, Imagen 3, ... | |

| Kling | Kuaishou | Kling 2.0, Kling 3.0, ... |

| Midjourney | Midjourney | Midjourney v5, v6, v7, ... |

| Nano Banana | Nano Banana 2, Nano Banana Pro, ... | |

| Qwen | Alibaba | Qwen2-VL, ... |

| Recraft | Recraft | Recraft V3, ... |

| Reve | Reve | Reve Image 1.0, ... |

| Seedream | ByteDance | Seedream 2.0, Seedream 3.0, ... |

| Stable Diffusion | Stability AI | SD 1.5, SD 2.1, SDXL, SD3, ... |

| StyleGAN | NVIDIA | StyleGAN2, StyleGAN3, ... |

| Z-image | Alibaba | Z-image, Z-image Turbo, ... |

| Other generators | Various | Generators with a smaller audience |

And more, new generators are added continuously as they appear in the wild.

Video generators

| Generator | Creator | Example versions detected |

| Higgsfield | Higgsfield AI | Higgsfield 1.0, Higgsfield Soul Cinema... |

| Kling | Kuaishou | Kling 1.0, Kling 1.5, ... |

| Midjourney | Midjourney | Midjourney Video, ... |

| Pika | Pika | Pika 1.0, Pika 1.5, ... |

| Runway | Runway | Gen-2, Gen-3, Gen-4... |

| Seedance | ByteDance | Seedance 1.5, Seedance 2.0, ... |

| Sora | OpenAI | Sora, Sora 2, ... |

| Veo | Veo 1, Veo 2, Veo 3, ... | |

| Wan | Alibaba | Wan 2.1, Wan 2.2, ... |

| Other generators | Various | Demamba, HotShot, LaVie, Hunyuan, Ray... |

And more, new generators are added continuously as they appear in the wild.

La détection est basée sur les pixels de l'image et non sur les métadonnées. Les résultats ne sont pas altérés si les métadonnées ont été supprimées ou s'il n'y a pas de watermark.

Les watermarks et métadonnées ne sont pas toujours intégrées dans les images générées par IA. Lorsque les utilisateurs envoient une image vers des applications ou des plateformes populaires, les métadonnées sont automatiquement supprimées.

The OpenAI, MidJourney, Google, Gemini, Stable Diffusion, Flux, Ideogram, Grok trademarks and logos are the property of their respective trademark holders. They are not affiliated with Sightengine.

... et accessible via une API pour une utilisation à grande échelle.

Notre API a été conçue pour et par des développeurs. Copiez-collez quelques lignes de code et le tour sera joué !

curl -X POST 'https://api.sightengine.com/1.0/check.json' \

-d 'api_user={API_USER}' -d 'api_secret={API_SECRET}' \

-d 'url=https://sightengine.com/assets/img/examples/example7.jpg' \

-d 'models=genai'

Scalable à l'infini. Modérez aisément votre contenu quelque soit la charge. De quelques éléments à des milliards d'éléments par mois.

Confidentialité totale. Aucun besoin de modérateur humain. Le contenu de vos utilisateurs n'est vu par personne. La confidentialité est respectée.

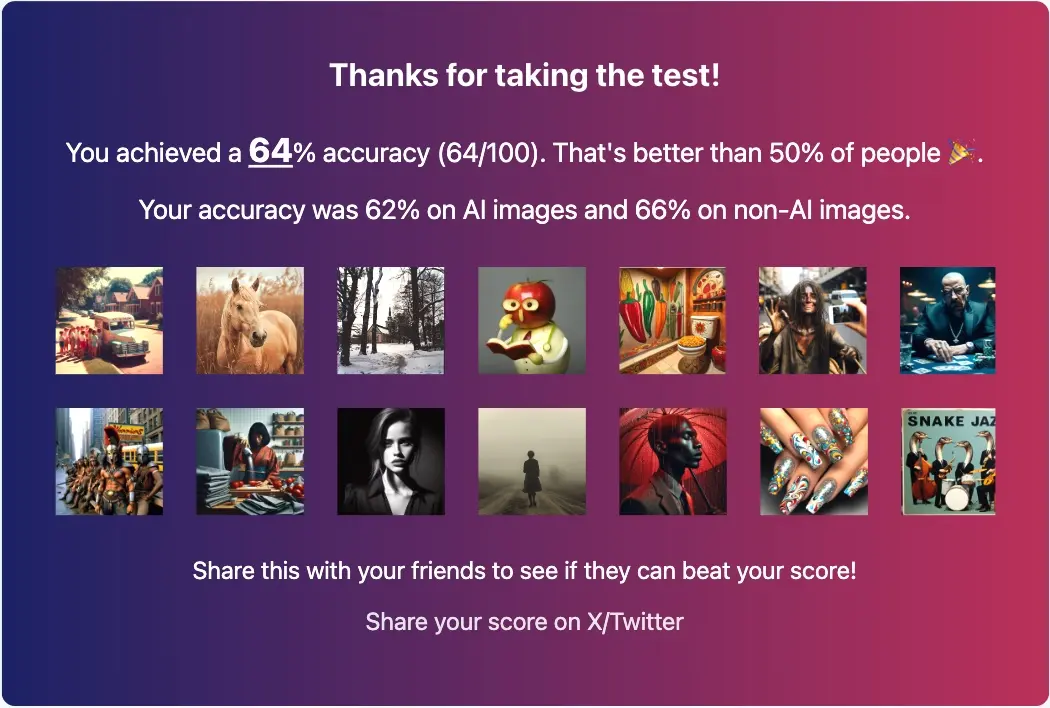

Une précision surhumaine.

Nos tests montrent que les humains peinent à détecter les images générées par IA, alors que les modèles spécifiquement entraînés pour les détecter dépassent largement les performances humaines.

Êtes-vous prêt à relever le défi ? Faites notre test en ligne pour comparer vos résultats !

Un produit qui fait partie de notre gamme d'analyse de contenu intégrée

Nous offrons un ensemble complet de modèles pour analyser et modérer votre contenu visuel : Modération, Analyse ou Extraction de contenu.

Modération Image

Modérerez les images générées par vos utilisateurs. Détectez tout contenu indésirable tel que le contenu pour adulte, les propos haineux, la violence, la présence de mineurs et plus encore. En savoir plus sur notre API de Modération d'Images

JPEG PNG WebP GIF...

Modération Vidéo

Analysez les vidéos statiques et les diffusions en direct en temps quasi réel. Repérez les contenus indésirables tels que la violence, les contenus pour adulte, les médias illégaux ou qui ne respectent pas vos conditions d'utilisation. En savoir plus sur notre API de Modération de Vidéos

MP4 AVI MOV HLS RTSP...

Foire Aux Questions

Comment est-il possible de déterminer si une image our vidéo est générée par IA ?

Les médias générés par IA contiennent souvent des artefacts subtils et des incohérences qui peuvent être détectés par des outils spécialisés. Ces outils identifient des motifs caractéristiques des images synthétiques, ce qui aide à les distinguer des photos réelles.

How accurate is the AI image detector?

In an independent benchmark by researchers at the University of Rochester and the University of Kansas using 80,000 images across multiple generators, our detector achieved the highest accuracy among the tools tested. Accuracy depends on the generator, image quality, and post-processing; no detector is 100% reliable, and results should be combined with human judgment.

Does it work without metadata or watermarks?

Yes. Detection works on the pixel content of the media itself. It does not rely on EXIF metadata, C2PA provenance tags, or visible watermarks, all of which are commonly stripped when images are uploaded to social networks, messaging apps, or marketplaces.

Which AI image generators can it detect?

The detector covers all major current generators including Nano Banana, GPT 2, Grok Imagine, Midjourney, DALL-E 3, Imagen 3 and 4, Stable Diffusion (SD 1.5, SDXL, SD3), Flux, Ideogram, Adobe Firefly, Bing Image Creator, and GAN-based face generators. The detector is updated continuously as new generators are released.

Can it detect deepfakes and face swaps?

Yes. Alongside AI image & video detection, we offer dedicated deepfake detection that identifies face swaps and AI-driven face manipulations. Both run on the same upload, so you receive a combined assessment.

Is this the same as a deepfake detector?

They overlap but are not identical. AI detection identifies any image/video generated or substantially edited by AI. Deepfake detection specifically identifies face swaps and facial manipulation, which is a narrower task. We provide both, and most users benefit from running them together.

How do you handle new AI image & video generators?

We monitor new generators continuously and add them to the detector typically within a few weeks of release. There is usually a short window after a model launches when detection accuracy on its outputs is lower than for established generators.

Les détecteurs IA peuvent-ils remplacer le jugement humain ?

Bien que le détecteur de médias générés par IA fournisse des informations en temps réel, il ne doit jamais être utilisé comme un substitut au jugement humain. Différents détecteurs peuvent avoir des niveaux de précision variables. Il est essentiel de faire preuve de discernement lorsque vous évaluez leurs résultats.

Quelles sont les limitations aux détecteurs IA ?

Les détecteurs de médias générés par IA peuvent produire des résultats imprécis: des faux positifs ou des faux négatifs. Notre détecteur peut aussi avoir des difficultés avec les contenus produits par des générateurs de médias IA qu'il ne connaît pas, tels que les plus récemment lancés. Dans certains cas, les images peuvent également avoir été fortement modifiées pour tenter d'échapper à la détection.

Que signifie le score fourni ?

Le score indique le degré de confiance de l'API dans sa prédiction. Un score élevé suggère une plus grande probabilité que le contenu soit généré ou modifié par IA, tandis qu'un score plus faible indique le contraire. Même si l'API renvoie un score très haut ou très bas, comme 99% ou 1%, il est important de tenir compte du contexte et de faire appel au jugement humain dans l'évaluation finale.

Comment prenez-vous en compte les nouveaux générateurs de médias IA ?

Nous testons l'API avec des nouveaux générateurs dès leur arrivée sur le marché, et nous les prenons en compte pour entraîner les détecteurs à les reconnaître. Veuillez noter qu'il existe en général un bref délai entre la sortie d'un nouveau générateur et son intégration complète dans notre système.